8月にネインは、ヒアラブルデバイス「Zeeny Lights」とにじさんじ所属のVTuber「鈴原るる」さん「健屋花那」さん「白雪巴」さんとのコラボレーション企画を発表し、受注予約を受付させていただきました。

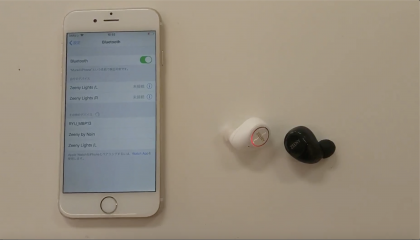

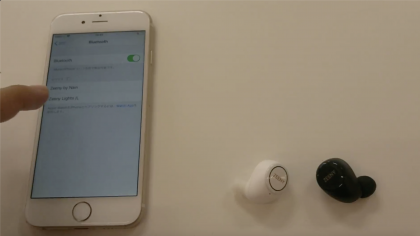

ヒアラブルデバイスZeeny(ジーニー)の最大の特徴は「音声通知機能」です。

LINEなどのメッセージや、アプリからの通知、時報やスケジュール、バッテリー残量などを、スマホを取り出すことなく音声で聞いて、確認することが可能です。

もちろん、音楽再生や通話も可能。外の音を聞きやすくする機能を使えば安全に使用できます。

あなただけの、あなたにしか聞こえない「音声アシスタント」として日々の生活で活用してもらえるようなデバイスを目指して、開発を頑張っております!

そして現在、このコロナ禍で人と人が距離を取らなければならない、今まで当たり前だったことがスムーズにいかない中、多くの人がたくさんの我慢を何ヶ月も続け、やがて新しい生活様式が生まれました。

会社や学校に通うこと、仲間や恋人との外食や遠出、心を揺さぶられるライブや舞台などのエンターテインメント、好きなスポーツチームの応援など…なくなっても死なないけど、どんどん心が乾いていくような感覚になっていませんか?

そんな中、「音声アシスタント」であるZeenyから日々聞こえる声が好きな人の声だったり、聞くだけで元気が出る声だったら?

それだけでも心に潤いをもたらせるのではないか?と考え、コラボレーション企画を立ち上げました。

そして、そのミーティングの中でメンバーが言った「耳元で逢える」というフレーズが強烈なインパクトとして残りました。

私が耳元で逢いたい声は誰だろう?と考えた時に、個人的に応援している、プロ野球チームの東京ヤクルトスワローズのホームである「神宮球場」で聞く「パトリック・ユウ」さんのアナウンスを思い浮かべました!

プロ野球も開幕が遅れ、無観客試合を経て、5000人から球場の50%までと観客を入れて今年のシーズンは行われております。

まだ、声を出しての応援はできないものの、改めて球場で野球を観られる喜びと楽しさを味わっている野球ファンが大勢いるのではないでしょうか?

2020年のシーズンも残りわずか…

「シーズンオフ中も、神宮球場にいる感覚になりたい!」というのを実現できるデバイスが「Zeeny Lights × パトリック ・ユウ」モデルなのです!

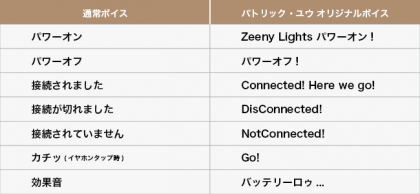

プロ野球「東京ヤクルトスワローズ」や、B.LEAGUE「サンロッカーズ渋谷」、ジャパンラグビートップリーグなど、バイリンガルMCとして国内国際大会問わず、様々なスポーツの現場をアナウンスで盛り上げるパトリック・ユウさん。その録り下ろしボイスを、操作音や時報、さらにシークレットボイスとして聞くことが可能です。

神宮球場で聞けると嬉しいあのフレーズなんかも入れられたら嬉しいなぁ…とまだまだ搭載するボイスを考えています!

さらに、10/15(木)まで下記回答フォームからアンケートを実施中!搭載して欲しいパトリックさんのセリフを募集しておりますので、どしどしお答えください!

■回答フォーム:https://forms.gle/4QpFwNetWzKg6n118

※皆様からいただいたセリフの中から厳選し搭載いたします。

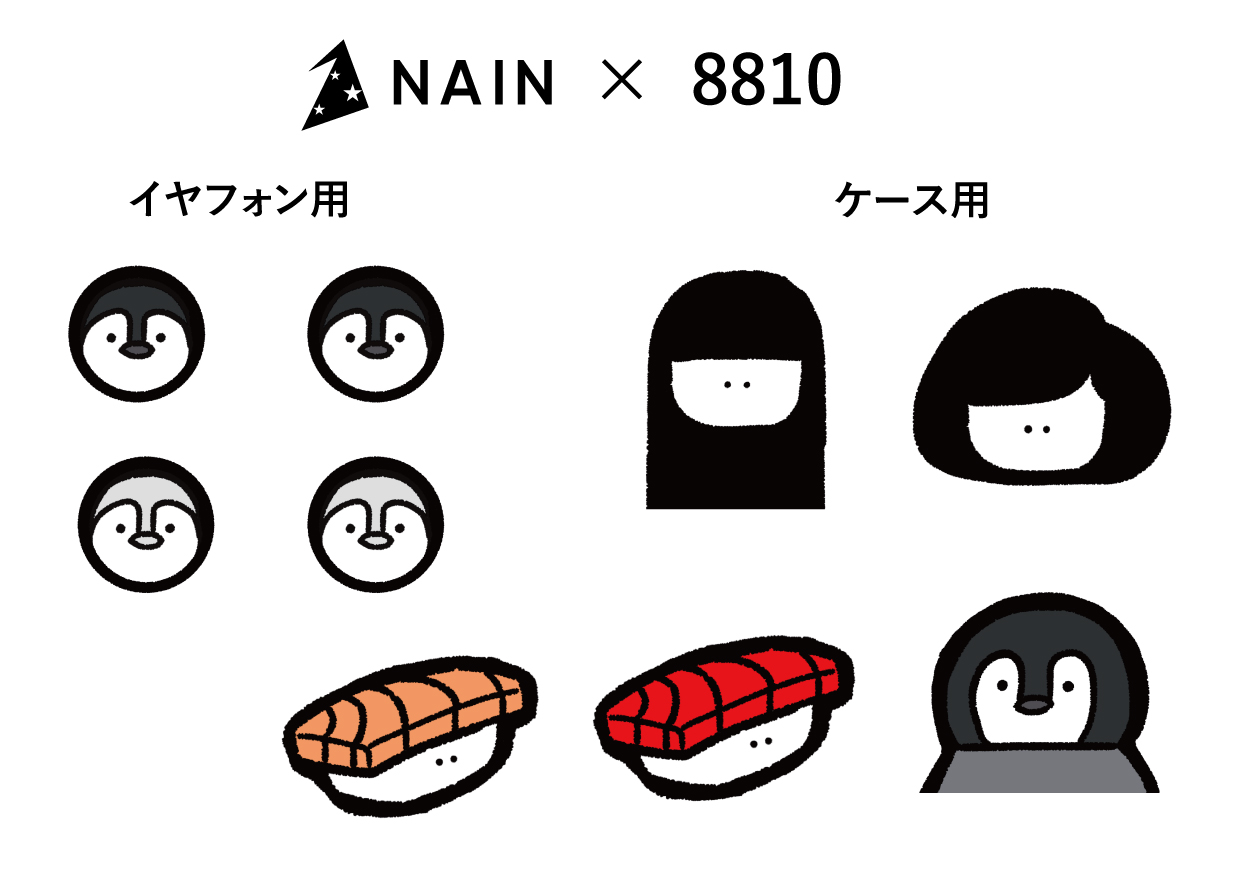

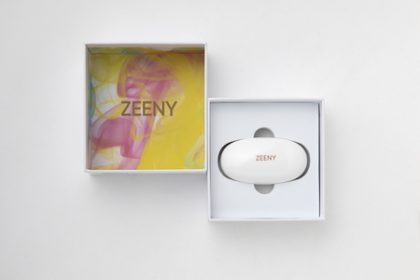

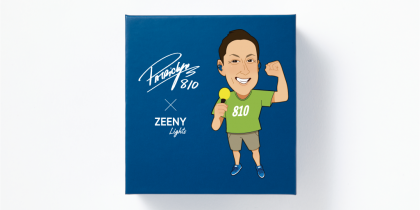

パッケージには、東京ヤクルトスワローズのグッズなどのイラストも描いているイラストレーターのhicoさんのパトリックさん描き下ろしイラスト!

デバイス本体のデザインも左右でパトリックさんをイメージしたデザインになっています。

予約はこちら:https://zeeny.com/products/zeeny-lights-patrickyu

予約販売概要

■購入方法: 通信販売ウェブサイトZeeny.comにて予約販売

■予約期間: 2020年10月1日(木)13:00から2020年11月1日(日)23:59まで

■製品発送: 2020年12月下旬より順次発送予定

■販売価格: 9,800円(税別・送料別)

■販売元 : 株式会社ネイン

※販売期間については状況により、予告なく変更する場合がございますので、予めご了承ください。

パトリック・ユウさんとのコラボモデルに搭載予定のサンプルボイスをご紹介!

あなたは耳元で逢いたい人はいますか?

または、耳元に逢いに行きたい(コラボしていただける)方がいらっしゃいましたらぜひネインまでお問い合わせください!

問い合わせ先:https://zeeny.page.link/collaboration

多くの人の心の渇きを潤して元気が湧いてくるようなデバイスやアプリなど、ネインができることを全力でこれからも頑張っていきますので、コラボで初めて知っていただいた方も、引き続きよろしくお願い致します!